当你分析网站日志的时候,往往会发现现在有各种各样的奇怪爬虫,典型的比如:chatgpt。

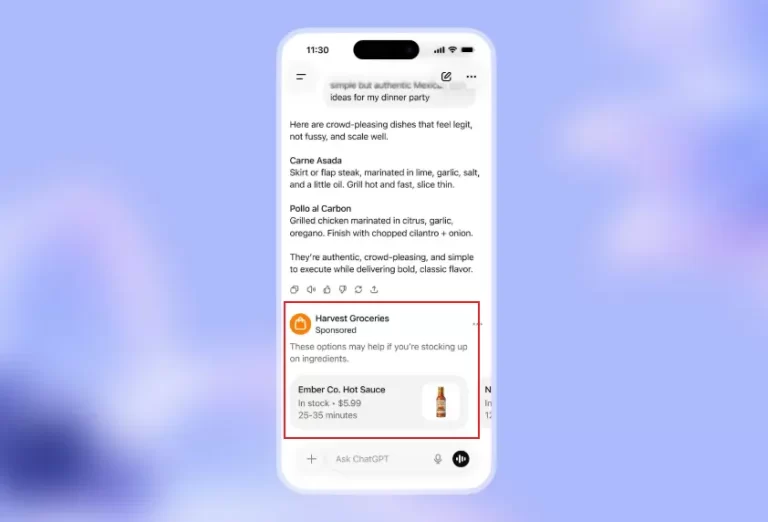

幻觉,一直是各大AI厂家的心头恨。

而解决这一问题的最佳方法,就是联网搜索,指望搜索引擎的API不现实,除非你是gemini和文心一言。

那么为了长久之计,最好的办法是——自己亲自去爬。

对于站长而言,这既是好处,也是坏处。

有可能这些爬虫一个流量带不来,还把你的内容“白嫖”过去。

也有可能直接把你的服务器爬崩了。

所以这里整理一下2026最新的AI爬虫特征,是屏蔽还是欢迎,见仁见智。

所有AI爬虫整理

要决定是对它们“关门放狗”还是“扫榻相迎”,首先得认清它们的脸。

现在的AI爬虫早就不像几年前那么单纯了,它们有的为了搜,有的为了学,有的纯粹就是来捣乱的。

为了方便大家在服务器日志(Log)里抓现行,我把截止2026年1月,市面上最活跃、最主流的几个“大户”特征全部扒了出来。

1. OpenAI系:分家后的“三驾马车”

OpenAI 在2025年做了一个对站长极其重要的改动:把“搜索”和“训练”拆开了。这点非常关键,直接决定了我们的GEO策略1。

OAI-SearchBot- 身份: SearchGPT 的御用探针。

- 特征: 这是目前GEO(生成式引擎优化)的核心。它抓取你的页面,是为了在用户提问时,把你的内容作为“答案”呈现,并附上链接。

- 态度: 它是来送流量的,不是来白嫖的。

GPTBot- 身份: GPT模型的“饲养员”。

- 特征: 它抓取内容纯粹是为了喂给GPT-5(或更高版本)的大模型做训练数据。

- 态度: 被它抓走的内容,会变成模型肚子里的知识。用户问到了,模型会直接回答,大概率不会给你留链接。属于典型的“教会徒弟,饿死师傅”。

ChatGPT-User- 身份: 披着机器皮的人(或Agent)。

- 特征: 当用户在ChatGPT里开启“浏览模式”并点击你的链接时,或者使用Canvas功能时,就会出现这个UA。

- 态度: 这是实打实的访客,千万别手滑给封了。

2. Google系:藕断丝连

谷歌毕竟是搜索起家,它的爬虫逻辑非常鸡贼,它把“不让训练”和“不让收录”做成了两个开关2。

Googlebot- 身份: 传统搜索 + AI Overviews(AI综述)。

- 特征: 还是原来的配方。你要想在Google上有排名,就得忍受它把你的内容拿去生成AI Overviews。目前无法在保留排名的同时拒绝AI综述。

Google-Extended- 身份: 一个专门的“防白嫖”协议。

- 特征: 这是一个独立的控制令牌。如果你在 robots.txt 里封禁了它,Google 就承诺不会拿你的数据去训练 Gemini 的底座模型,但不影响你在搜索结果里的排名。

- 态度: 这是一个非常有用的“遮羞布”。

3. Perplexity:流量黑马

PerplexityBot3- 身份: “答案引擎”的先锋。

- 特征: 它的逻辑是“即时搜索+总结”。虽然它也白嫖内容,但它引用来源的意愿目前看来比OpenAI要强。

- 风险: 抓取频率极高,甚至有点像DDos。很多国外大媒体(如纽约时报、福布斯)都曾公开屏蔽过它,但在GEO领域,它也是目前仅次于SearchGPT的第二大流量源。

4. Anthropic (Claude):高冷学霸

ClaudeBot- 身份: Claude 模型的训练爬虫。

- 特征: Claude 目前在“联网搜索”这块的动作不如OpenAI激进,它抓取更多是为了提升模型智商。

- 态度: 极少带流量,基本属于纯消耗服务器资源。

5. Apple:生态封闭者

Applebot-Extended- 身份: Apple Intelligence 的训练开关。

- 特征: 和谷歌类似,这是苹果给出的选择权。你可以允许 Applebot 抓取以便让 Siri 找到你,但通过封禁这个 Extended 版本,拒绝让你的数据进入苹果的生成式模型训练集。

6. 国内及其他

这里主要点名两个:

Bytespider(字节跳动)- 身份: 豆包、今日头条等字节系产品的爬虫。

- 特征: 抓取频率略高,大家根据自己的情况调节。

CCBot(Common Crawl)- 身份: 互联网数据的“批发商”。

- 特征: 它不是为了某个特定的AI,它是把全网数据爬下来,打包成数据集,然后开源给全世界的AI公司去训练。

- 态度: 只要你被它爬了,基本等于你的数据被全地球的AI都白嫖了一遍。早期的GPT、现在的各种开源模型,吃的都是它的奶。

如何屏蔽和放行

哈哈,收到。咱们确实得低调点,毕竟服务器还要在国内混,不能太“直抒胸臆”。

对于Bytespider这种“勤奋”的爬虫,我们更多是从服务器资源分配的角度去考量,而不是单纯的屏蔽。毕竟带宽也是钱,电费也是钱。

下面接着来,代码直接抄作业。

如何屏蔽和放行

既然搞清楚了谁是来送客的,谁是来进货的,接下来的操作就简单了。

所有的生杀大权,其实就在根目录那个小小的 robots.txt 文件里(有些厂商可能不会遵守,到时候需要服务器级别的反爬)。

这不仅仅是几行代码,更是你对网站未来的“站队”。

你是想拥抱AI搜索的新流量?还是想严防死守保护原创版权?

我整理了三种最典型的配置方案,你可以根据自己的服务器承受能力和运营策略,对号入座。

方案一:GEO 激进派(我全都要)

如果你跟我一样,觉得 SearchGPT 和 Perplexity 是未来的流量风口,并且愿意为了这个可能性,牺牲一点被“训练”的风险。

那么,你需要给那些带有“搜索属性”的 AI 爬虫开绿灯。

尤其是 OpenAI,一定要分清楚:我们要拒绝它的训练,但欢迎它的搜索。

User-agent: OAI-SearchBot

Allow: /

User-agent: PerplexityBot

Allow: /

User-agent: GPTBot

Disallow: /

解读: 这么写的意思是:SearchGPT,请进来把我的内容展示给用户看;但是 GPT-5,请不要把我的文章拿去训练模型。虽然咱们也无法验证它到底听不听话,但至少在协议上,我们把姿态做足了。

方案二:服务器“节能”派(防白嫖模式)

如果你的小水管服务器经不起折腾,或者你压根不相信 AI 能给你带流量,只相信 Google 和百度这种老牌搜索引擎。

那么,就把那些纯训练的、或者对你业务没帮助的爬虫,统统关在门外。

特别是 Common Crawl,这个全网数据的“批发商”,屏蔽它能帮你省下一大笔流量费。

User-agent: GPTBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: Google-Extended

Disallow: /

解读: 这就叫“只许看不许吃”。Google-Extended 的加入,保证了你的网站依然能被 Google 收录排名,但不会被拿去喂给 Gemini 模型做训练。

方案三:针对“高频”爬虫的特别关照

关于字节系的 Bytespider,客观来说,它的抓取效率确实非常高。

如果你的业务主要面向国内,且希望在豆包等产品中有展现,建议保留。

但如果你主要做英文站,或者发现服务器负载报警了,可以尝试用 Crawl-delay(抓取延迟)来跟它商量商量,让它爬慢点;实在不行,再考虑屏蔽。

Plaintext

User-agent: Bytespider

Crawl-delay: 10

(注:不是所有爬虫都遵守 Crawl-delay,但写上总比不写强。)

总而言之,主要还是根据你的业务要求,你需要谁,就放行谁,不需要的,就直接屏蔽。

另外也要有一些直接不署名或者“假冒正规搜索引擎的”爬虫,这种建议先用nslookup指令看一下服务器地址,如果不是正规来源的,直接屏蔽了就行。

省心版Robots.txt

如果你懒得每天盯着日志分析,也不想去纠结哪家公司又出了什么新模型,只想要一个“既保流量,又防白嫖”的万能配置。

那么,直接把下面这段代码复制粘贴到你网站根目录的 robots.txt 文件里。

核心逻辑很简单:

- 默许所有搜索引擎(Google, Bing, SearchGPT, Perplexity)进入,保证流量来源和SEO优化不受影响。

- 精准狙杀纯训练爬虫(GPTBot, Claude, CCBot),拒绝为大模型免费打工。

- 启用“防训练”开关(Extended协议),告诉 Google 和 Apple:搜我可以,训我不行。

# --- 基本原则:默认允许所有爬虫 (为了SEO和GEO流量) ---

User-agent: *

Allow: /

# --- OpenAI:拒绝 GPT 训练,但 SearchGPT 仍可抓取 ---

User-agent: GPTBot

Disallow: /

# --- Google:拒绝 Gemini 训练,但 Google 搜索仍可收录 ---

User-agent: Google-Extended

Disallow: /

# --- Apple:拒绝 Apple Intelligence 训练,但 Siri 仍可搜索 ---

User-agent: Applebot-Extended

Disallow: /

# --- Anthropic:拒绝 Claude 训练 ---

User-agent: ClaudeBot

Disallow: /

# --- Common Crawl:拒绝全网数据打包 (防白嫖的一大杀器) ---

User-agent: CCBot

Disallow: /

# --- Facebook/Meta:拒绝 Llama 模型训练 ---

User-agent: FacebookBot

Disallow: /

# --- 亚马逊:拒绝 Alexa/Titan 模型训练 ---

User-agent: Amazonbot

Disallow: /

写在最后

GEO(生成式引擎优化)是一个正在快速演变的战场。

今天的“省心版”配置,也许到了2026年下半年就需要更新。因为AI厂商也在博弈,他们可能会换个马甲(User-Agent)继续爬,也可能会推出新的协议。

但万变不离其宗:作为站长,我们欢迎互利共赢的“搜索”,拒绝单方面的“索取”。

这就是我们在 AI 时代最后的倔强。